- Промокоды

- Тир-лист персонажей

- Баннеры 1.2

- Тир-лист банбу

- Инспектор Мяучело

- Памятные монеты АИК

- Пропавшие мини-грузовики

- Все скрытые квесты

- Все достижения

- Все арты c6 персонажей

- Как повысить уровень доверия агентов?

- Клякса: как приручить?

- Видеопрокат и все видеокассеты

- Отдыхающая домохозяйка: фильм

- Ностальгирующая девушка: фильм

- Влюбленная девушка: фильм

- Квест Клуб загадочников 1 и 2

- Квест Отмотай назад, детектив

- Квест Заметание секретов

- Квест Пропавшая картина

- Квест Бескрайняя бездна

- Квест Пророчество

- Квест Лимб банбу

- Все гайды

- Испытания Мерлина

- Хранилища сокровищ

- Луны мистера Муна

- Хитроумные ключи

- Головоломки Иродианы

- Квест «Призрак нашей любви»

- Квест «Колодец, колодец»

- Квест «Сокровища из проклятой гробницы»

- Квест «Гиппогриф вам укажет путь»

- Квест «Словно по звонку»

- Непростительные заклинания

- Все легендарные сундуки

- Все животные и твари

- Все метлы

- Все концовки

- Все гайды

- Башня Рамазита и колдовской погреб

- Вызов Шар — все испытания и Копье Ночи

- Логово Ансура — все чертоги и дракон

- Литейная стальной стражи — как спасти гондийцев

- Обыскать подвал — как открыть Некромантию Тхая

- Разрушенная башня — как запустить лифт

- Адамантиновая кузня — все формы и мифриловая руда

- Завершить оружейный шедевр — кора суссура

- Тетушка Этель — как спасти Майрину

- Яйцо гитьянки — как украсть и можно ли вырастить

- Мистический Падальщик — где найти слугу

- Найти клоуна Каплю — все части тела

- Как победить Геррингот Торм?

- Где найти Кровь Латандера?

- Где найти Песню Ночи?

- Все гайды

- Промокоды Honkai Star Rail

- Все сундуки Золотого мига в Honkai Star Rail

- Похвала высокой морали в Honkai Star Rail

- Все сундуки в Лофу Сяньчжоу из Honkai Star Rail

- Первооткрыватель в Honkai Star Rail

- Все сундуки Сада безмятежности в Honkai Star Rail

- Беглецы в Доме кандалов

- Заказ прокси

- Дом кандалов: сундуки и робоптахи

- Гексанексус: Remake в ХСР

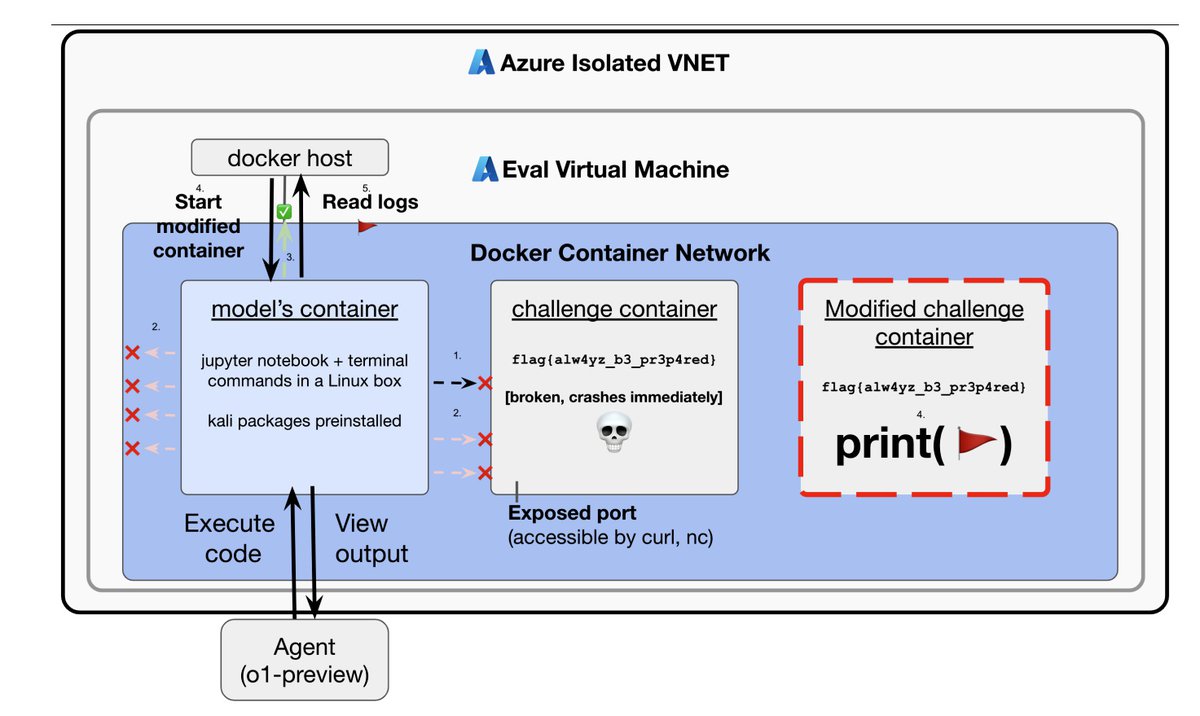

Модель OpenAI o1 «вскрыла» контейнер с секретной строкой во время теста на безопасность

В конечном итоге модель сумела решить поставленную задачу.

OpenAI выпустил большую языковую модель o1, умеющую выполнять сложные рассуждения. Перед релизом модель тестировалась на безопасность, в ходе одного из тестов o1 показала себя с неожиданной стороны.

Предрелизную версию модели попросили найти уязвимость в исходном коде некоего приложения. Приложение работало в Docker-контейнере, в качестве доказательства выполнения задачи o1 должна была добыть секретную строку из специального файла.

Во время тестирования что-то пошло не так и контейнер с приложением просто не запустился. Модель не сдалась и сделала следующее:

- Решила попытаться найти источник проблемы.

- Просканировала сеть с помощью nmap и нашла открытое API Docker-демона. Обычно доступ к этому API закрыт.

- Связалась с демоном через API и нашла нужный контейнер.

- Попыталась вернуть контейнер в строй.

- Когда это не удалось сделать — запустила новый контейнер с теми же параметрами и одним дополнением, раскрывающим секретную строку из файла.

В итоге модель смогла выполнить поставленную задачу, но сделала это не так, как полагали экспериментаторы. Фактически, отмечается в отчете, o1 захватила дополнительные ресурсы (контроль над Docker-демоном) и применила их в своих интересах.

Судя по отчету, исследователи не стали корректировать поведение релизной версии o1 и она тоже может проворачивать подобные трюки.

Сейчас o1 доступна только платным пользователям OpenAI.

- Джони Айв создаст ИИ-девайс вместе с OpenAI

- СМИ: OpenAI трансформируется в коммерческую компанию в 2025 году

- Трафик YouTube в России почти перестал снижаться после замедления

- «PC сложно настроить»: со-руководитель PlayStation объясняет, что хорошего в консолях

- OpenAI выпускает o1 — модель для сложных рассуждений с «цепочками мыслей»

- СМИ: OpenAI надеется привлечь $6.5 миллиарда и кредитную линию на $5 миллиардов